2024/2/25 NEW PARTY@高円寺DevelopmentBase ライブ振り返り

Overview

友人から「ライブやんない?」と誘われたので二つ返事でやると答えて出演。

基本的にスケジュールの都合さえ付けば、やらないという選択肢はないのだ。

2024.2.25AT 高円寺DB BAR DEVELOPMENT BASE

— 村上裕 daily work 燃料 裸の特異点 素人 aka mile (@murashi8) February 10, 2024

17:00 start 2500yen サンシマイベイビーズ キライ hacha Yoshitaka S.T. memorycarderror hiroshi murakami 村上 裕 pic.twitter.com/prn18vhE4B

共演者の何人かは年明けにやったイベントでもライブを見ていて、比較的エクスペリメンタルなことが受け入れられそうな雰囲気なので、試してみたかったスタイルを2つやってみることにした。

beatfaderライブ

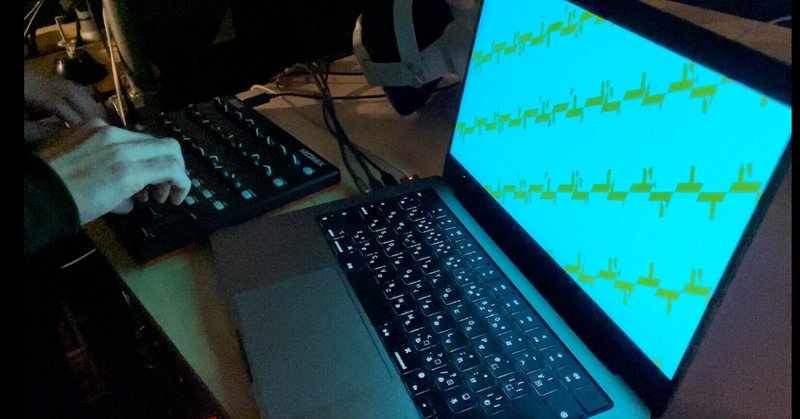

1つ目はbeatfaderを使ったAudioVisualライブ。

少し前にたまたま知ったプラグインなのだが、DJコントローラーなどのフェーダーを動かすとnoteが発生するMIDIプラグインみたいなもの。

詳しい内容は下記参照。

なんか面白そうだったので買ってみて、色々ドラム音源いじってみたりScale(音階)を絞って鳴らしてみたりと遊んでいたし、せっかくだから一回ぐらいはライブやっとくか、と。

機材

コントローラーはAKAI MIDI MIX。

AKAIはどうもノブが低くてあまり好みではなくあまり使ってなかったのだが、KORG nanoKONTROL Studioでガチャガチャやってたらフェーダーが取れちゃうし、NOVATION LaunchControl XL MK2も激しく動かすにはちょっとフェーダーが重い。

結果的に手持ち機材の中ではMIDI MIXがフェーダーの長さ的にもちょうどプレイしやすかったのでこれにした。

システム

AbletonLiveでちゃんとシステムを組んで実際にライブやったのは、実は初めてかも。

8つフェーダーあるので4つはドラム音源に割り当て、残りをLeadっぽいシンセをMinorPentatonicで適当に鳴らした。

ノブにもVolumeと、Looperの長さ、音源別に固有のパラメータなどを割り当てた。

流石にこれ一本で三十分とかは間が持たないかなと思うが、まぁ軽く十分程度なら悪くないのでは。

あるいは音源をスイッチしていくような仕組みも入れるか。

個人的には元より演奏スキルがあるわけではないので、システムを構築して誰が触ってもそれなりに楽しいものを作り上げるってとこが肝かな。

メタな音楽観というか。

本質的に音楽ってのは聞くものじゃなくてやるもんなんだぜって気持ちがあるからかもしれん。

映像について

映像は取って付けた程度ではあるが、hydraでMIDI入力を受けて何かしら動いてりゃいいかなぐらいのものをあらかじめ作った。

ただシステムも映像ももっと練り込む余地は十二分に残してる感じがあるので、再構築してもう一度ぐらいライブやってもいいかもしれない。

一応コードを晒しておく。

わざわざOnXXX()とか定義したくせにただ変数に入れてるだけなのは、本当はここでremapだったり複雑な加工をするつもりで定義したんだけど、実際には名付けようのないパラメータの連続でかったるくなったから。

コメントアウトされたkaleid(6)あたりが、いつもの自分のスタイルを捨てきれなくて執着してる感じがしてヤだねぇ。

正直なところ、ビジュアルはもうちょっと練り込んでも良かったんじゃないかとは思う。

モジュラーシンセライブ

数年前にモジュラーシンセに興味を持ったのだが、流石に物理に手を出すのは金と置き場所の問題を考えるとちょっとな、と思ってたらSynthVR(Steam/Quest)と出会った。

不思議とこの時はVCV Rackには行かなかったんだよなぁ、なんか見づらくて。

一時期しばらく触っていたが開発が止まっていて機能が増えていかないので何となく離れていた。

それが先にも上げたイベントでモジュラーシンセ使いの共演者を見てたら再燃して、せっかくなら一度ぐらいはこれでライブやりたいなと思ってやってみた。

思想

即興主義者なのでライブやるならやはり即興。

それも物理ではやりづらいような、その場でゼロからモジュールをどしどし追加してパッチングしていく完全即興をやりたいと思って、やった。

これには個人的な思想が強く反映されている。

例えば、ライブコーディングだ!って言って、完全に組み上げたコードを持ち込んで再生ボタン押すだけだったら果たしてそれはライブコーディングと言えるのか?否だろう。

ではパラメータだけ書き換えて変化させたらどうか?

まぁライブコーディングかどうかは0/1じゃなく度合いの問題だと思うが、個人的には自分がやるパフォーマンスとしては納得しない。

ただ数値を変えるだけならコードじゃなくてMIDIコンへのマッピングでいい。

そういう風に考えていくと、わざわざ高機能なDAWではなくVRモジュラーシンセで即興のパフォーマンスをやるとなったら、どういうものを見せるべきなのかを自分なりに考えてここに至った。

また、過度にタイミングや音程をクオンタイズしたりすることに対してちょっと疑問を持っていて、そんな整った音楽をやるならDAWでやる方がやりやすいと思う。

むしろそこから逸脱するような、ちょっと奇妙な音の出し方をする方がモジュラーシンセらしいのかなと思ったりする。

極めて基礎的なモジュールだけを組み合わせて音を作っていくと、色々と勉強になって面白い。

感覚的にはshaderを学ぶのと近しいんだよね。

いずれも低レベルな領域に手を突っ込んでるからこそ、キレイにパッケージされてしまったプロダクトにはないアナーキーさがそこにはある。

ただ、まだまだ自分自身のモジュラーシンセへの理解は浅いので、あくまで現時点での自分の捉え方かな。

大層なことを書いてはみたが、実際のクオリティ自体は自分でもまだまだ低いなぁという気はする。

でもなぁ、作り込むにはSynthVRでは非力すぎるし、あくまでパフォーマンスを見せる方向でもうちょっと練り込みたいかな。

機材構成

MetaQuest3でSynthVRを動かし、USBでMBPに接続してscrcpyで映像を受け取って外部ディスプレイへミラーリング。

音はMetaQuest3のイヤフォンジャックから直接ミキサーへ。

ネットワーク環境が良ければキャストする方が見やすいと思う。

ちなみにscrcpyは下記のようなパラメータで片眼の出力をクロップした。

scrcpy -f --audio-source=mic --max-size=1920 --stay-awake --crop=1210:1100:140:180あと、一度こういう環境でQuest3を使ってみたかった。

クラブやライブハウスのように全体的に薄暗い環境でどこまでQuest3が使い物になるのか、ならないのかを検証しておきたかった。

更には動き回る特徴点があったりとなかなか過酷な環境だと思ったが、意外とドリフトすることなく安定して使えていた。

Quest3君、なかなか優秀じゃん。

問題点

実際にやってみて問題点は幾つかあった。

まずやたらバリバリとノイズが入る。

これは恐らくQuest3に挿したオーディオケーブルが接触したためではなかろうか。

後頭部に養生して緩和できないかと試みたが、やっぱりちょっとノイジーだったかな。

後になって気付いたがオーディオを直接Quest3から出すんじゃなくて、scrcpyでラップトップに引き込んでそこから出せば良かったのでは?

そしてQuest3だと負荷に耐えられず、ちょくちょくClockのテンポに乱れがあった。

やってる時はリバーブ系のモジュールの負荷じゃないかとか、スピーカーを置きすぎたからだとか思ったけど、改めて見直すとパッチングする前からワーニングが出ているタイミングがあった。

使いそうなモジュールをたくさん空間に並べておいて、必要に応じてそれを掴んで配置するということをやっていたが、もしかすると単純にモジュールを置きすぎていると負荷が高いのかもしれない。

もうちょっと妥当な数まで絞り込んだり、あらかじめスピーカー数を限定して手前にミキサー置いて束ねたりしておくとこまではセットアップするとかの工夫は必要そう。

ただこの辺りの問題はQuest3版じゃなくて、Steam版で強めのゲーミングPCを持ち込めば力技で解決できる問題な気もする。

これだけは言わせて

リアルタイムでケーブル(コード)をパッチングしてライブしたらさ、それってライブコーディングってことじゃね!?(ドヤァ)

おまけ(共演者ダイジェスト)

@murashi8 https://t.co/2u2wdBULfH pic.twitter.com/3vURzzZ4l7

— hacha (@hacha) February 26, 2024

@ununhate https://t.co/2u2wdBULfH pic.twitter.com/nZHdUZ91vO

— hacha (@hacha) February 26, 2024

この記事が気に入ったらサポートをしてみませんか?