ChatGPTやBYODで考える、セキュリティガイドラインの作り方!!

みなさん、情報資産を守るためにセキュリティ対策してますか?大変ですよね😇

当社でも同じで、大変な中、事業との両立を実現する為にどういったポリシーでセキュリティを維持するのが良いのか、試行錯誤を繰り返ししながら業務に励んでいます。

今日はそんな当社のセキュリティの一端をセキュリティ担当の木下からお話させていただきます。

セキュリティガイドラインってなぜ必要なの?

企業経営する上で、セキュリティポリシーやセキュリティ規程・ガイドラインを設ける必要性は、以下のような理由からあります。

ビジネスリスクの軽減

情報セキュリティ上のリスクは、ビジネスリスクとしても認識されます。情報資産の損失やデータ漏洩などによって、顧客や業界の信頼性が失われたり、裁判費用や罰金などの負担が発生する可能性もあります。セキュリティポリシーや規程/ガイドラインを設け運用することで、これらのリスクを軽減することができます。

コンプライアンス

情報セキュリティに関連する法律や規制が存在します。これらの法律や規制を遵守するためには、適切なセキュリティ対策が必要です。セキュリティポリシーや規程/ガイドラインを設け運用することで、法律や規制に適合することができます。

これらのような理由から、セキュリティポリシーや規程/ガイドラインを設けることは、企業経営において重要な課題の一つであり、ビジネスの信頼性や安定性を確保するために不可欠なものです。

とはいえ、これらを運用するのって大変ですよね?

よく見聞きする大変になるポイント(課題)を挙げてみます

大変になるポイント

運用が手間(管理する側も利用する側も)

利用者(従業員)から見た時の課題

ちょっとしたデータの共有でも、申請して承認取ってシステムを登録/変更してもらうなど、時間と手間を要する

管理者から見た時の課題

上記のように “ちょっとした” ケースでもシステム変更対応などが必要になるので、対応工数が大きくなる

セキュリティ要件が達成できない事により、業務でできる事が制限されてしまう

利用しようとしていたシステムがリスクがあるという事で禁止される

委託先のセキュリティ対策ができていないという事で、一部の業務が委託できなくなった

こういうのがよく見聞きする課題かなと思います。

これらの課題を解決するにはどうしたらいいのでしょうか?

銀の弾丸はありませんが、私が思う重要なポイントを書いていきます。

これらの課題を解決するには

結論から書きますが、重要なのは

「ちゃんとリスクを評価して、必要なセキュリティ対策を使い分ける事」

です。

みなさんの会社でも様々な情報資産を取り扱っていて、その中には個人情報もあれば、営業資料だったり、広く公開している情報もあるのかなと思います。

この色々ある情報資産について、全て同じセキュリティ対策で運用しようとすると、いろんな不都合が出てきてしまいます。実際にありそうな例を挙げて考えてみましょう。

ChatGPTを業務利用する際のセキュリティを考えてみる

ChatGPTは非常に便利そうなので積極的に利用したいのですが、何も考えず利用した場合どうなるでしょう?

ChatGPTに限らずですが、こういう類のサービスの情報の取り扱いは、大きく分けると下記のようなパターンがあるのかなと思います。

アップロードしたデータは、サービス提供事業者からは一切見えないし、利用する事もアクセスする事もない。

アップロードしたデータは、サービス提供事業者から見ようと思えば見えるが、原則アクセスしない。ただし、サービス提供に必要な範囲でアクセスする場合がある。

アップロードしたデータは、特定の目的で利用される。

例えば、何も考えず顧客の個人情報を含んだデータや重要な機密情報をChatGPTにアップロードしたとすると、上記3のようなケースで、特定の目的で利用される事や、その結果第三者へそのデータが漏洩するような事が考えられます。これってダメですよね?

逆に、リスクがあるから全面的に禁止した場合どうなるでしょう?

いろんなメリットがありそうなのに、その恩恵を一切受けられなくなります。本末転倒ですよね?

何も考えずOKとするのも、全面的に禁止する事もやりたくありません。そういう状況ではどうするのがいいでしょう?

ChatGPTのリスクを評価して考える

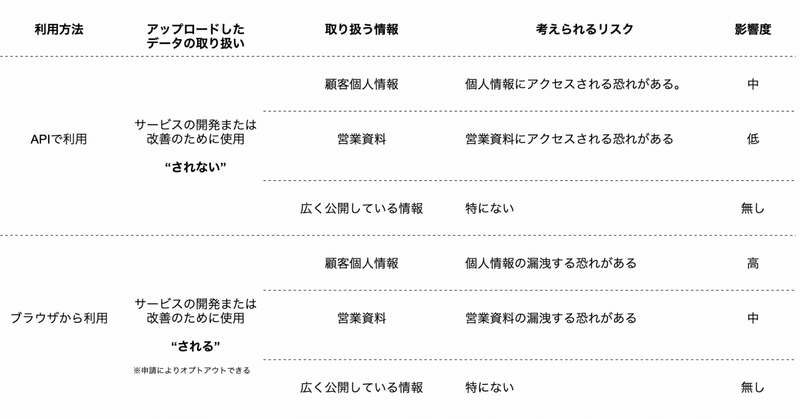

ChatGPTの場合、情報の取り扱いは上記2(APIで利用)と3(ブラウザから利用)に該当するようです。※ 内容の正しさを保証するものではありません

仮にですが、利用を想定している情報資産に下記のような物があるとします。

顧客個人情報

営業資料

広く公開している情報

それぞれどういったリスクがあるかを評価します。

「高」は避けなければならないリスクで、アップロードして返ってきたデータもアップロードしたデータと同様の取り扱いが必要な事や、投げたデータを特定の目的で利用する事に対してオプトアウトが可能だとすると、下記のように整理する事ができると思います。

利用するシステムのデータの取り扱いについて

必ず事前に規約やポリシーを確認する

規約などは随時変更がかかるものなので、定期チェックなど、変更をキャッチアップできるようにする

変更があった場合は運用も見直す

ChatGPTへアップロードするデータについて

ブラウザで利用する場合

個人情報の利用は禁止

営業資料や公開情報の利用は可能

APIで利用する場合

特に制限なく利用可能 ※当社がそうしてるという事ではありません

ChatGPTから返ってきたデータについて

ChatGPTに投げたデータが営業資料だった場合、返ってきたデータも原則営業資料と同様の取り扱いとする。

オプトイン / オプトアウトについて

API利用だったとしてもオプトインした場合は、ブラウザから利用した際と同様とみなす

逆にブラウザからの利用だったとしてもオプトアウトした場合は、APIから利用した場合と同様とみなす

このようにすれば、何も考えず利用を許可した場合や、全面的に禁止した場合のリスクを回避しつつ、メリットを享受できるのではないでしょうか?

上記は箇条書きで簡単に書きましたが、これらをきれいな文章にすればガイドラインとして利用できるんじゃないかなと思います。

BYODについてのセキュリティを考えてみる

私物PCや委託先PCの利用なんかも同様に考えられるかなと思います。

こちらも同じく「高」以上は避けなければならないリスクとすると、下記のように整理できるかなと思います。

顧客個人情報(Box)へアクセスする為の要件

セキュリティ対策で保護された会社PCでのアクセスが必要。私物PCや委託先のPCなどからのアクセスは不可。

営業資料(Google Drive)へアクセスする為の要件

セキュリティ対策で保護された会社PCでのアクセス

私物や委託先のPCでアクセスする場合は、セキュリティチェックシートの内容に準拠した対策の実施が必要

公開情報へアクセスする為の要件

特になし

これらはあくまで例なので、自社に合わせた設計を考えてみてください。

まとめ

最後まで読んでいただきありがとうございます。

今回は、よく議論の的になりそうな例を挙げて、セキュリティガイドラインの作り方を書いてみました。

今回のこのブログで私が1番伝えたかったのは、

「ちゃんとリスクを評価して、必要なセキュリティ対策を使い分ける事」

です。

これができていないと、情報漏洩のリスクや事業にブレーキをかけてしまうなど、いろんなデメリットを被る事になってしまいます。

セキュリティは利便性とのトレードオフとよく言われますが、我々が目指すのは「セキュリティがしっかりしているからこそアクセルを踏み込む事ができた」と評価されるセキュリティです。

今回のブログが少しでも皆さんの参考になれば嬉しいです。

TryHarder!!

現在、私たちの仲間になってくれる人を積極的に募集していますので、少しでも興味を持っていただけた方は下記よりご連絡いただければと思います。