最近の記事

- 固定された記事

A1111:v1.80インストールコマンド(一時ディレクトリ用):VRAM消費検証とReforumの使用雑感:2024/5版

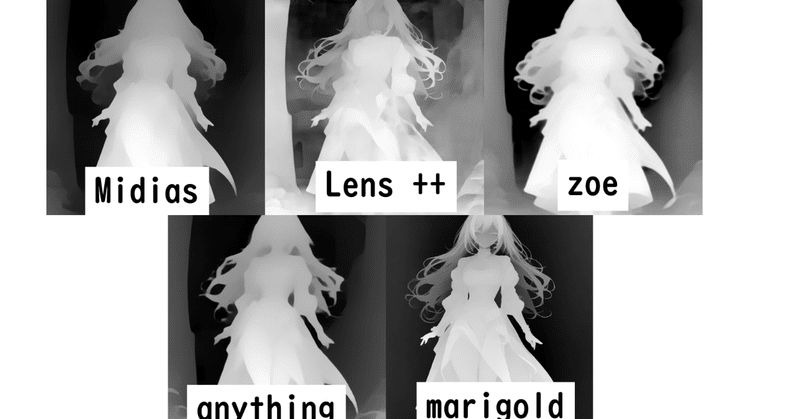

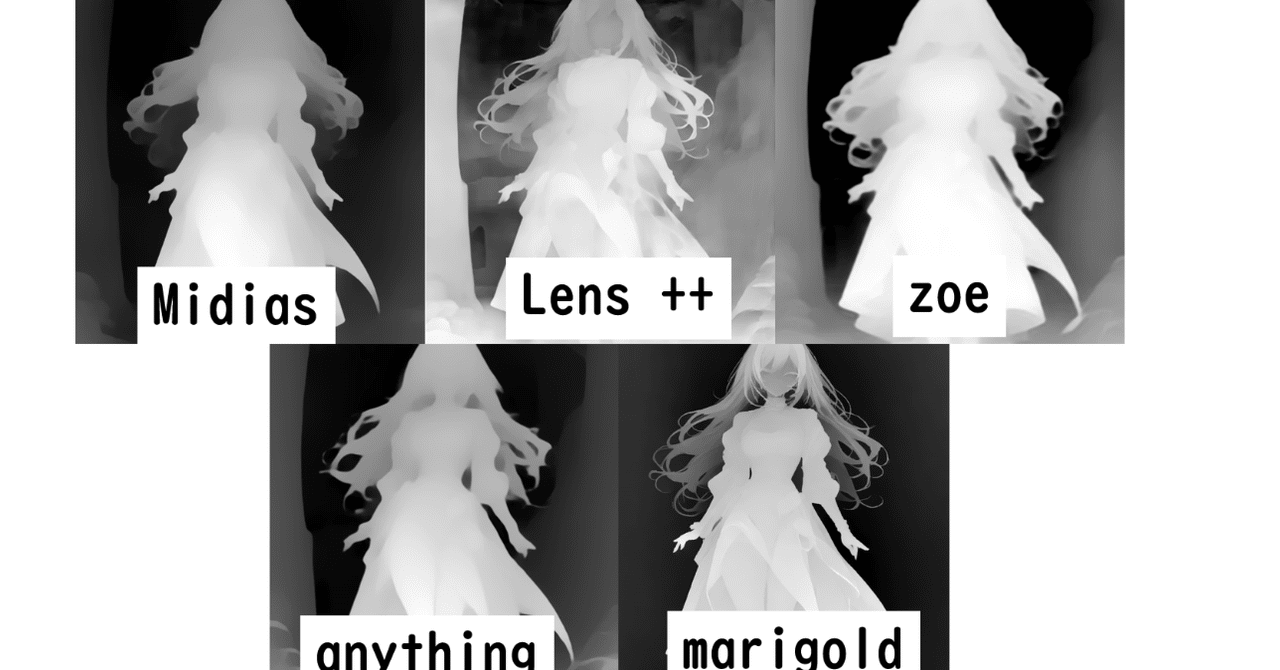

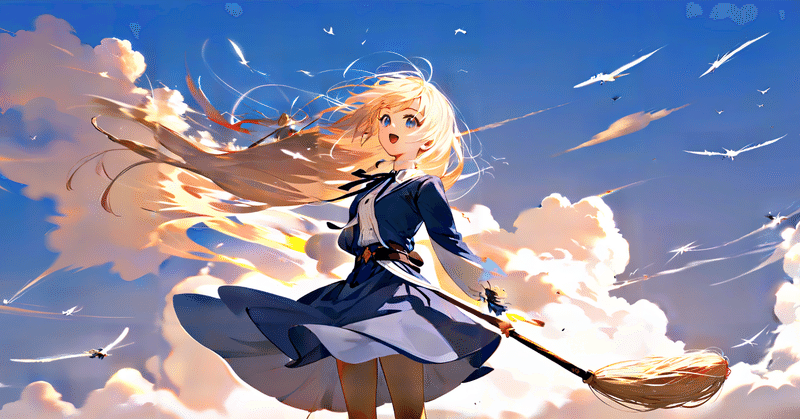

以前の記事で、ReforumというDeforumの実験的なブランチの紹介をしました。Forgeでも使用可能なのですが、A1111だとコントロールネットも使用出来るため、その方法について模索していました。 表題にあるように、最新のA1111のバージョンはv1.93なのですが、その特徴の一つである、「サンプラー」と「スケジューラー」を分けて設定するという機能に対応していません。 そのため、「サンプラー」だけ選ぶという形になると画像が劣化してしまうパターンが発生してしまいます。 そ