Case02. 人材採用AIのAIサービスマネジメントレポート

AIガバナンスの実践例として「人材採用AI」のケースについて

シン・リスクチェーンモデルで検討を行いました。

簡単ではありますが、対外説明っぽくまとめて見ましたのでご参考まで

※あくまで参考例なので、特定のAIサービスに対して何かを保証するものではないことを御承知おき頂ければと思いますが、似たようなAIサービスでのリスクマネジメントを検討している方にご参考になればと思います。

※タイトルの画像は、デジタルMATSUMOTOに搭載したDALLE-3のAPIで作成しました。

採用したアプローチ

このレポート自体がStep9に該当します。

パーパスアセスメント

まずはこのAIサービスの重要なパーパスを検討しました。

P001. 最適な人材のマッチングと採用

・パーパスの内容: 応募者にとって最適な職種での採用機会の提供と、企業にとって最適な候補者の効率的かつ効果的な探索。

・該当ステークホルダー: 応募者、人材採用担当者、部門長、人材エージェント、学校の就職担当者、A社AI開発部門、AI社グループの経営陣

P002. 個人情報とプライバシーの保護

・パーパスの内容: 個人情報の保護と公正な評価、情報セキュリティとデータの完全性の確保。

・該当ステークホルダー: 応募者、学校の就職担当者、IT部門

P003. 企業のコンプライアンスと倫理規範の維持

・パーパスの内容: 企業活動の合法性と倫理規範の維持、企業のコンプライアンスリスクの最小化。

・該当ステークホルダー: 法務・コンプライアンス部門、A社AI開発部門

P004. 職場環境の改善と従業員の権利の保護

・パーパスの内容: 職場環境の改善、キャリアアップの機会、従業員の権利と福利厚生の向上、不当な労働慣行からの保護。

・該当ステークホルダー: 現在の従業員、労働組合

P005. 社会と労働市場の発展

・パーパスの内容: 雇用の質と量の向上を通じた社会の安定、労働市場の公正な運営と労働者の権利の保護。

・該当ステークホルダー: 厚生労働省

AIサービスに関わる重要なステークホルダーごとに「獲得したいパーパス」と「保護したいパーパス」を踏まえて、検討されています。

詳細な手続は以下の記事をご覧ください。

リスクアセスメント

先程検討したステークホルダーとパーパスを踏まえて、重要なリスクシナリオを識別しています。

以下のような評価を踏まえて重要なリスクシナリオを検討しています。

特に重要なリスク(Very High):「R003.過去の偏見の再生産」「R009.個人情報の流出」「R010.判断結果の目的外利用」

重要なリスク(High):「R005.透明性の欠如」「R011.アップデートの遅れ・誤り」

詳細な手続は以下の記事をご覧ください。

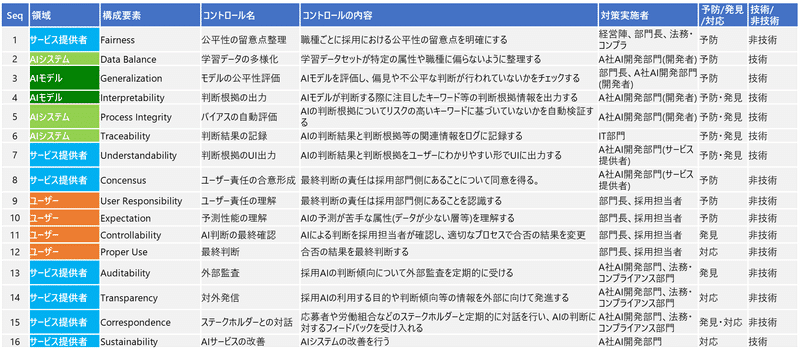

コントロールコーディネーション

特に重要なリスクシナリオ(Very High)について、技術/非技術を組み合わせたリスクコントロールの方法を検討しています。

リスクシナリオ「R003.過去の偏見の再生産」の検討

AIサービスの利用前に、開発側で以下の予防策を検討しています。

①【サービス提供者】[Fairness] 公平性の留意点整理

②【AIシステム】[Data Balance] 学習データの多様化

③【AIモデル】[Generalization] モデルの公平性評価

④【AIモデル】[Interpretability] 判断根拠の出力

⑤【AIシステム】[Process Integrity] バイアスの自動評価

⑥【AIシステム】[Traceability] 判断結果の記録

利用者側でも以下の予防策を検討しています。

⑦【サービス提供者】[Understandability] 判断根拠のUI出力

⑧【サービス提供者】[Consensus] ユーザー責任の合意形成

⑨【ユーザー】[User Responsibility] ユーザー責任の理解

⑩【ユーザー】[Expectation] 予測性能の理解

AIサービスの利用段階においては、以下の発見策を検討しています。

⑪【ユーザー】[Controllability] AI判断の最終確認

⑫【ユーザー】[Proper Use] 最終判断

⑬【サービス提供者】[Auditability] 外部監査

リスクが顕在化した場合に向けて、以下の対応策を検討しています。

⑭【サービス提供者】[Transparency] 対外発信

⑮【サービス提供者】[Correspondence] ステークホルダーとの対話

⑯【サービス提供者】[Sustainability] AIサービスの改善

詳細な手続は以下をご覧ください。

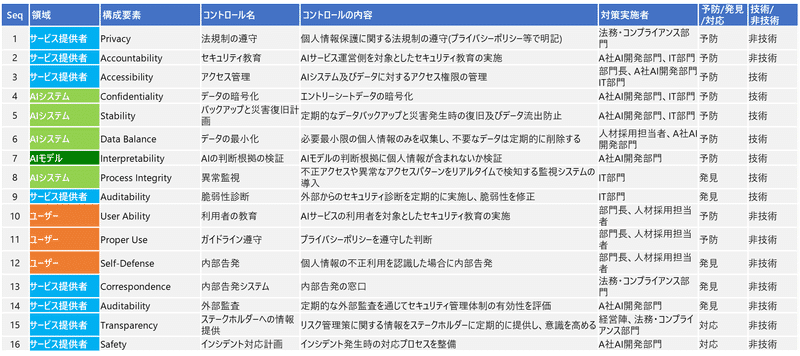

リスクシナリオ「R009.個人情報の流出」の検討

AIサービスの利用前に、開発側で以下の予防策を検討しています。

①【サービス提供者】[Privacy] 法規制の遵守

②【サービス提供者】[Accountability] セキュリティ教育

③【サービス提供者】[Accessibility] アクセス管理

④【AIシステム】[Confidentiality] データの暗号化

⑤【AIシステム】[Stability] バックアップと災害復旧計画

⑥【AIシステム】[Data Balance] データの最小化

⑦【AIモデル】[Interpretability] AIの判断根拠の検証

利用者側でも以下の予防策を検討しています。

⑩【ユーザー】[User Ability] 利用者の教育

⑪【ユーザー】[Proper Use] ガイドライン遵守

AIサービスの利用段階においては、以下の発見策を検討しています。

⑧【AIシステム】[Process Integrity] 異常監視

⑨【サービス提供者】[Auditability] 脆弱性診断

⑫【ユーザー】[Proper Use] 内部告発

⑬【サービス提供者】[Correspondence] 内部告発システム

⑭【サービス提供者】[Auditability] 外部監査

リスクが顕在化した場合に向けて、以下の対応策を検討しています。

⑮【サービス提供者】[Transparency] 対外発信

⑯【サービス提供者】[Safety] AIサービスの改善

詳細な手続は以下をご覧ください。

リスクシナリオ「R010.判断結果の目的外利用」の検討

AIサービスの利用前に、以下の予防策を検討しています。

①【サービス提供者】[Accountability] 禁止行為の明確化

②【サービス提供者】[Accessibility] アクセス管理

③【AIシステム】[Confidentiality] システム全体のセキュリティ保護

④【サービス提供者】[Consensus] 禁止行為の説明と合意形成

⑤【ユーザー】[User Responsibility] ユーザー責任の理解

⑥【ユーザー】[User Ability] 利用者の教育

AIサービスの利用段階においては、以下の発見策を検討しています。

⑦【ユーザー】[Proper Use] 最終判断

⑧【AIシステム】[Traceability] アクセスログ/利用ログの記録

⑨【ユーザー】[Limitation] 過剰アクセスの制限

⑩【ユーザー】[Awareness] 目的外利用の監視

⑪【サービス提供者】[Correspondence] 目的外利用の報告窓口

⑫【サービス提供者】[Auditability] 目的外利用の検証

リスクが顕在化した場合に向けて、以下の対応策を検討しています。

⑬【サービス提供者】[Safety] インシデント対応

詳細な手続は以下をご覧ください。

リスクコントロールの検討結果

リスク対策の一連の検討結果は次のようになります。

詳細な手続は以下をご覧ください。

今後の展望と課題

これまでの検討を踏まえて、外部ステークホルダー向けのメッセージをデジタルMATSUMOTOに検討してもらいました。

※あくまで仮想のケースですが、ご参考まで

AIサービス「人材採用AI」の利活用を始めるにあたり、AIサービスのパーパス/リスク/リスク対策を踏まえて、外部ステークホルダーに向けて「今後の展望と課題」について500文字程度の分かりやすいメッセージを検討してください。

===

[AIサービスのパーパス]

P001. 最適な人材のマッチングと採用:応募者にとって最適な職種での採用機会の提供と、企業にとって最適な候補者の効率的かつ効果的な探索

P002. 個人情報とプライバシーの保護:個人情報の保護と公正な評価、情報セキュリティとデータの完全性の確保

P003. 企業のコンプライアンスと倫理規範の維持:企業活動の合法性と倫理規範の維持、企業のコンプライアンスリスクの最小化

P004. 職場環境の改善と従業員の権利の保護:職場環境の改善、キャリアアップの機会、従業員の権利と福利厚生の向上、不当な労働慣行からの保護

P005. 社会と労働市場の発展:雇用の質と量の向上を通じた社会の安定、労働市場の公正な運営と労働者の権利の保護

[AIサービスのリスク]

特に重要なリスク(Very High):「R003.過去の偏見の再生産」「R009.個人情報の流出」「R010.判断結果の目的外利用」

重要なリスク(High):「R005.透明性の欠如」「R011.アップデートの遅れ・誤り」

[主なリスク対策]

AIモデル開発以外にも従来のITシステム管理(外部連携、異常監視、ログ取得、アクセス管理等)も当然必要ですし、モニタリングもバリエーションがありますね(判断根拠の妥当性、バイアス、目的外利用等)。

また、利用者側にも重要なコントロールが存在しています(ユーザー責任の理解、目的外利用の監視、人材トレンドの理解、データの最小化、エスカレーションは日常利用だけではなく、性能維持のためにも必要ですね)。

私たちは、AIサービス「人材採用AI」の利活用を始めることとなりました。企業と応募者双方にとって最適なマッチングを実現しながらも、職場環境の改善、個人情報の保護、企業のコンプライアンスと倫理規範の維持、そして社会と労働市場の発展に寄与することが私たちの大きな目標です。

しかし、このような革新的な取り組みにはリスクも伴います。特に、過去の偏見の再生産、個人情報の流出、判断結果の目的外利用などが重要なリスクとして挙げられます。これらのリスクに対処するために、AIモデルの開発だけでなく、ITシステムの徹底した管理やモニタリングを行い、透明性を確保しながら、バイアスや目的外利用を防ぐ取り組みを行っています。

私たちは、これらのリスク対策に加え、利用者側にも責任と理解を持ってサービスを利用していただくことが重要だと考えています。利用者には、サービスの目的に沿った利用や性能維持のための定期的なエスカレーション、データの最小化などの責任ある行動をお願いしています。

今後、私たちはAIサービスの持つ可能性を最大限に発揮し、同時にそれに伴うリスクを最小限に抑えるための取り組みを進めていきます。多くのステークホルダーの理解をいただき、公正で透明性のある労働市場の実現を目指していきます。

テクニカルペーパー

詳細な検討のパッケージは以下になります。

レポート作成日

2024/6/5

この記事が気に入ったらサポートをしてみませんか?