記事一覧

【After Effects】Motion Toolsが使えなくて困った件【解決した】

なぜかCreative Cloud Desctopからはアンインストールできなかったので、ZXP/UXPインストーラーからアンインストールしたよ

※Motion Toolが正常に稼働したあとに、CCDを見たら、

「・・・」が有効になってアンインストールできるようになってました

CCD:マケプレ→プラグイン→プラグインを管理

Live2D切り抜きプラグイン使ってみた

実際に使ってみたところ…

外側のパーツ分け

外側のパーツ分けは頭頂部の補完までしてくれるので、【標準搭載の生成塗りつぶし】に軍配が上がる

※本来透明になるべきところは透明で塗りつぶししてほしいし、頭頂部の補間もしてほしい

内側のパーツ分け

ネクタイを分ける場合

かなりいい実装してるんだけど、ズレがストレス

新規に作成されるレイヤーがキャンバスの中心を見てるから左右対称じゃないとずれるのか

文化庁パブコメ結果読んだ

パブコメ結果公開されました

生成AI利用者の観点から、大事そうなところ3つまとめました

◯いわゆる無断学習と特定LoRA

◯類似性、依拠性、故意性の有無

特定loraや特定名詞を用いたプロンプトをしない限りは、仮に類似するようなイラストが生成され、依拠性が確認されても差し止めに留まる

※依拠性はモデルに当該著作物が含まれる場合、利用者が当該著作物を知らなくても依拠性が成立する

手書きの場合

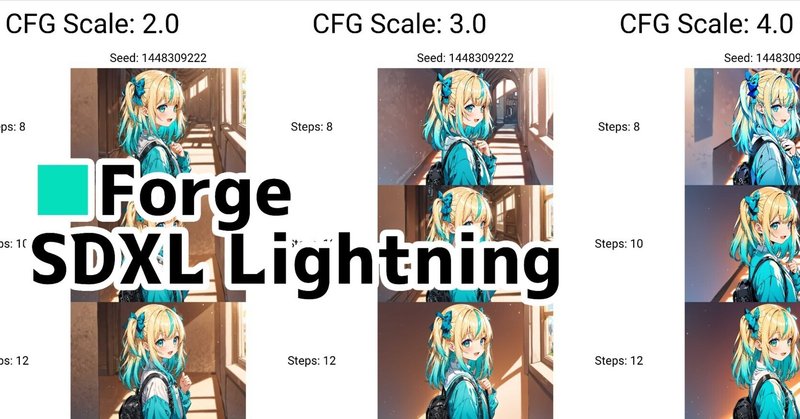

【生成時間半減】Forge SDXL-Lightning

Loraモデルを使用して比較してみました

RTX2070使うと1枚当たりだいたい半分くらいの生成時間で済みました

scale3/step10-12あたりがいい感じです

【Forge】 embeddingsとLora読み込みしない【checkpoint同系統しか読まないっぽい】

結論 SDXL系checkpointを使用している場合、embeddingsとLoraはSDXL系のみ読み込む

1.5系は1.5系のembeddingとloraを読み込む

※コメントありがとうございます!

パッケージの方でupdate.batでアプデしたらファイルがいくつか更新削除された。

その後run.batで Loraが読み込みされた。

embeddingsはリフレッシュしたら表示された。

AIと著作権に関する考え方についてのパブコメ案読んだ

■依拠性について

■ポイント

類似性に関して侵害と判断された場合、生成AI利用とそうでない場合の作成されたモノについて、依拠性の根拠になる既存の著作物を認識してるかどうかの扱い違うのがポイント

◯生成AI利用

→知らんでも、学習データに含まれる場合依拠性あり

◯生成AI利用なし

→知らんだらセーフ

臨界アストラクチャー ガイドライン

崩壊する未来都市で、青春を謳歌する女の子の近未来SFストーリー!

恋も友情も冒険も、すべてが臨界点に! あなたはどんな選択をする?

■企画説明

animagine XL 3.0の表現力がすごいので、架空のソシャゲっポイ雰囲気の世界観でいい感じのスチル作って遊んでいく企画です。いい感じのイラストが作成できたら #臨界アストラクチャー に投稿してください。

本企画はVtuberなつきちゃんのファン

【母音がキレイに表現できる】VTSマイクロリップシンクセットアップについて

はじめに

イラストレーター兼Live2Dモデラーの農家Vtuberのなつきちゃんです。

アドカレ12/22を担当します。

この記事ではVTSマイクロリップシンクセットアップについての

Live2DモデリングからVTSの設定までの

つまずきポイントを解説します。

あくまで私流の紹介記事になります。

よりよい方法があれば記事を更新しますのでご連絡いただけると幸いです。

記事最後に今回紹介する

原作未読勢が超解釈する葬送のフリーレンED解析

ノンクレジットED

はじめての同時視聴配信はじめて同時視聴やってたらEDのデザイン性が気になって、最後の2時間くらい出てくる花とか知らべてみたよ メモしたのでそのまま貼っとく

アニメ4話までの知識で解析していく~~!

不明な花わかる人いたらコメントよろ!!

新たに判明したら随時更新します

10/3更新解釈深堀り配信

前回の本記事メモを振り返りながら深堀り

解釈開始

不明な花には★をつけて

Warudoに2Dモデルを表示する方法

これのやり方です。

さらにScreenのAlwaysFaceCameraを有効します

カメラが動いても正面向くようになります!

このプラグインでwarudo上の3DモデルをVTSトラッキングで動かせるみたいです

※1つのウェブカメラで3Dと2Dを同時にトラッキングする方法わからなかったので、知ってる人コメント下さい🥺

両方動いてるように見えますが、動画では3Dの動きはカメラ追従にしてるだ

【初心者向け】ChatVRMをローカルで動かす

先日Pixiv公式から公開されたChatVRMをローカルで動かしていきます。

元記事

ブラウザ上で3Dキャラクターと会話できる「ChatVRM」をオープンソースで公開しました - pixiv inside

github(ソースDL先

pixiv/ChatVRM (github.com)

元記事ではデモ版としてweb上で動かせるのと、

ローカルにDLして動かす2つがあります。

web版はAPI

【AItuberやるぞ!】python使う準備【twitter運用編】【1/n】

プログラムなんもわからん超初心者がまとめるつまづきポイントまとめていきます※書きかけ随時更新です。

pipインストールエラー出るwin→cmdでコマンドプロンプト立ち上げてpip install ○○する

pipバージョン古いよ警告出るときpython -m pip install --upgrade pi

OpenAI API とtweepy導入 pip install openai

p

【ノーコード】画像とChatGPTで生成した文章を同時に自動ツイートできた話【Make×ChatGPT×image×twitter】

こんにちは、なつきちゃんです!(@natukichanFV)最近AIVtuberやるために、生成AI関係調べてます。今回は、おはV・おやVなど定型になりがちがツイートをChatGPTに任せていい感じのツイートにした上で、画像も添付しちゃおうといった内容です。

Makeの使い方

chatgpt→twitter自動投稿は下記動画を参照してください

手順通りにやれば、難なくできると思います

※ウチのチ

VTS待機モーション完全に理解した

待機モーション&表情入力に対応した物理演算揺れものを

同一パーツに実装したモデルをリリースしたので記事書いておきます

下記モデルの耳がピクピクって動くのが待機モーション

他はブレンドシェイプを使った物理演算です

待機モーション時にも物理演算で揺れるので、動きが豊かになります

前回の記事で、物理演算仕込んだパーツはアニメーションができないって記述しましたが、今回その問題を解決しました!

↓前回