3Dポイントクラウドデータの理解を目指した大規模言語モデル PointLLM

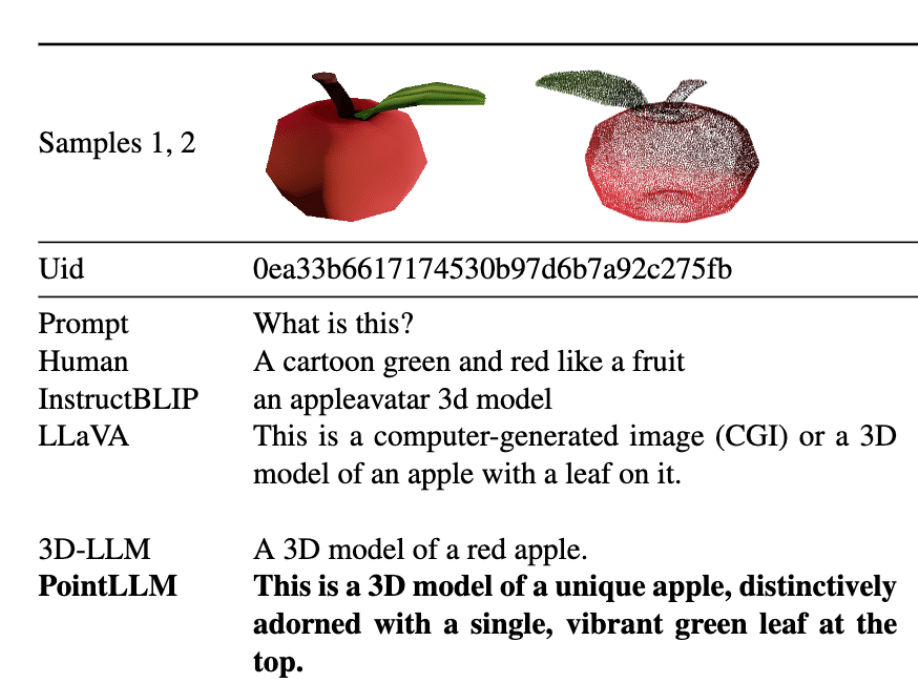

PointLLMはオブジェクトのカラーポイントクラウドを理解することができるマルチモーダル大規模言語モデルです。このモデルは、あいまいな深度、遮蔽、視点依存性の心配なく、オブジェクトの種類、幾何学的構造、および外観を認識します。2段階のトレーニング戦略を可能にするために、66万件のシンプルなポイント・テキスト指示ペアと7万件の複雑なポイント・テキスト指示ペアからなる新しいデータセットを収集しました。モデルの知覚能力とその一般化能力を厳密に評価するために、生成的3Dオブジェクト分類と3Dオブジェクトキャプショニングの2つのベンチマークを設定し、3種類の評価方法で評価しました。

PointLLM は、3Dポイントクラウドデータの理解を目指した大規模言語モデル(LLM)です。このモデルは、色付きのオブジェクトポイントクラウドを処理し、人間の指示に基づいて適切な反応を生成する能力を持っています。具体的には、ポイントクラウド概念の理解と文脈に応じた応答の生成を目的としています。

技術的アプローチ

PointLLMは、既存の2Dベースラインを超えるパフォーマンスを示しています。このモデルは、3Dオブジェクト分類と3Dオブジェクトキャプショニングのベンチマークを含む評価基準でテストされ、人間の評価者によって50%以上のオブジェクトキャプショニングサンプルで優れていると評価されました。このような能力は、3Dデータを扱うAIアプリケーションにおいて、特に有用です。

利用可能なリソース

開発者や研究者は、GitHub上でPointLLMのコード、データセット、およびベンチマークを確認することができます。これにより、コミュニティがこの技術をさらに探求し、独自のプロジェクトに応用することが可能になります 。

研究の意義

PointLLMの開発は、LLMが単にテキスト情報だけでなく、3D空間とそのデータを理解する能力を持つことを示しています。これにより、ロボティクス、仮想現実(VR)、拡張現実(AR)など、新たなアプリケーション分野での使用が期待されます。

この技術により、将来的にはよりダイナミックで直感的な人間とマシンのインターフェースが実現可能になると考えられます。このような進歩は、AIと人間の協働の新たな形を創出し、多くの業界で革新的な変化をもたらす可能性があります。