【イベントレポート】TECH in 京都#2

HACARUSでデータサイエンティストをしている増井です。

今回は2022年5月27日(金)に開催した社外勉強会TECH in 京都 #2 の発表内容を当日利用した発表資料と合わせて、ご紹介させていただきます。

TECH in 京都とは?

TECH in 京都は元々ハカルスの社内で開催していた技術勉強会の拡大版として運営する技術勉強コミュニティです。

TECHは、Technology Enhancement Community by HACARUS の略で、技術好きの方々がラフに集って学べる場をつくり、京都から面白いことを生み出していこうという思いが込められています。TECH in 京都は機械学習に限らず、システム開発やチームビルディングなど、技術に関するテーマであればなんでも学べる場にしたいと考えています。技術に興味のある方であればどなたでも参加OKとし、オープンなコミュニティの運営を目指しています。

今回は第二回ということで、前回同様オンラインで開催し、15名程度の方に参加していただけました。前回から引き続き参加されている方や、その紹介で参加していただけた方など、徐々に TECH in 京都の存在が広まってきていることを感じました。

イベントの内容

今回のテーマは「Interpretable Machine Learning ~ モデル非依存な解釈手法の紹介 ~」というテーマで、機械学習モデルの解釈性の話について紹介しました。

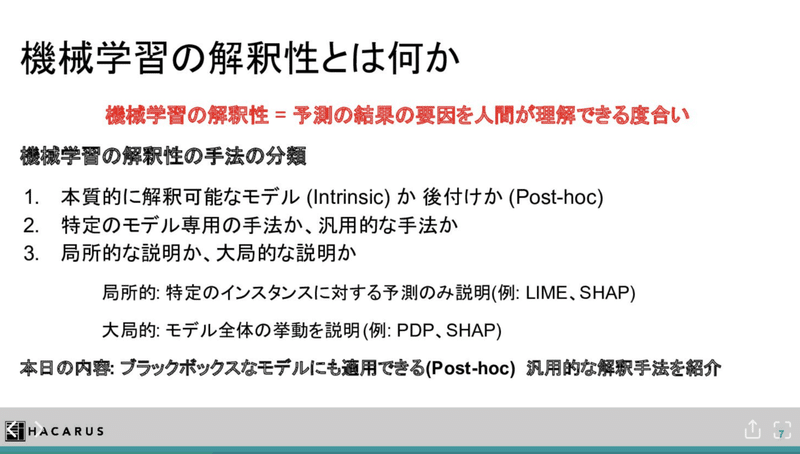

機械学習モデルの解釈性とは、何らかのデータから学習して得られた機械学習モデルが、何を根拠に予測結果を出しているのかを人間にとって理解しやすくするための技術と言えます。

機械学習が様々な分野で適用されていく中で、何を根拠に判断しているのかがブラックボックスであることが導入の障壁になっている例も少なくありません。そのようなときに、さまざまな解釈手法が提案されているのですが、各手法にはそれぞれ一長一短があります。今回は、機械学習の解釈手法のうち、代表的な PDP、ICE、 LIME、SHAP について解説させていただきました。

機械学習の解釈性については、HACARUS のデータサイエンティストが関心を持っているテーマの一つです。昨年、有志で Christoph Molnar の Interpertable Machine Learning ( https://christophm.github.io/interpretable-ml-book/ ) の和訳を作成して公開した経緯もあり、今回の発表内容は、この本を参考にしました。原著は、web で無料で読めるのですが、英語で読むのは厳しいという方は、こちらの和訳版をご覧ください ( https://hacarus.github.io/interpretable-ml-book-ja/index.html )

また、当日使用したスライドもこちらで公開しておりますので、ご興味がある方はご一読ください。

また、発表後には、参加していただいた方とざっくばらんにお話する座談会を行いました。発表時間内では質問できなかった、より突っ込んだ話や、各々の興味関心のあるトピックの話や、今後のTECH in 京都の話など、さまざまなやり取りがあり、少人数開催ならではの双方向のコミュニケーションができ、非常に楽しいイベントでした。

まとめ

今回は二回目ということで、前回よりも多くの方にご参加いただくことができました。今後とも、いただいたご意見ご感想を参考にしながら、より良い勉強会の場を提供できるように、引き続き HACARUS スタッフ一同尽力いたしますので、次回以降のご参加もお待ちしております。一緒に TECH in 京都 を盛り上げていきましょう!

最後に

ハカルスでは一緒に働く仲間を募集しています✨✨Wantedlyのページで募集しています。ぜひお気軽にご連絡ください🤝

この記事が気に入ったらサポートをしてみませんか?