AIを活用してジェンダー課題の解決を目指す。「富士通・お茶の水女子大学 AI倫理社会連携講座」

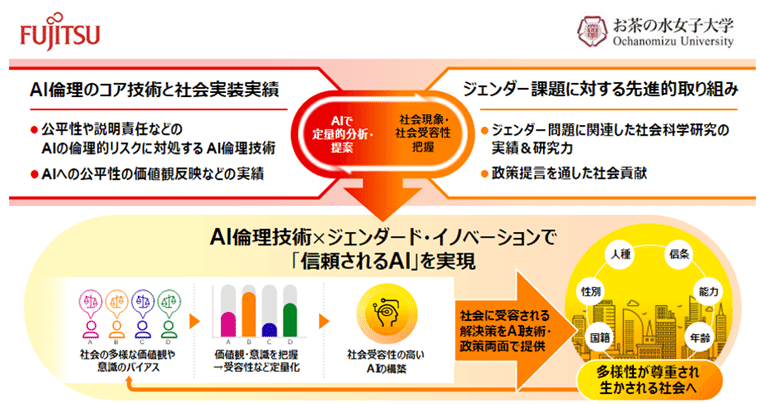

2023年3月、ジェンダー課題に対してAIを活用した解決策の立案を目指す連携拠点として、「富士通・お茶の水女子大学 AI倫理社会連携講座」が設立されました。

採用領域におけるジェンダー課題の解決をテーマに、現段階では、採用の意思決定において、女性に不利になるバイアスがないかAIで分析する研究を中心としています。

本講座で拠点長/社会科学チームリーダーを務めるのは、ジェンダード・イノベーション研究所 副研究所長の斎藤悦子教授。そして、講座担当者、技術戦略検討・研究推進を担うのは、富士通研究所人工知能研究所AIイノベーションコアPJ シニアリサーチマネージャーの新田泉さんです。

本記事では、お二人に、研究の過程で明らかになったことや産学の共同研究の重要性、そして今後のAIによるジェンダード・イノベーションの可能性まで、多岐にわたりお話を聞きました。

ジェンダー課題にAIを掛け合わせる可能性

ジェンダード・イノベーション研究所 副研究所長の斎藤悦子教授

━━まずは斎藤教授の研究内容、また、ジェンダード・イノベーション研究所に所属されている背景をお教えください。

斎藤教授(以下敬称略):私の専門は生活経済学と生活経営学で、個人や世帯が収入のために働く場所と、生活を行う家庭を行き来する際の問題を、ジェンダー視点から明らかにする研究をしてきました。

研究を開始した90年代後半、女性の社会進出が進んだとはいえ、育児を理由に退職する女性も珍しくないなかで、女性労働問題の解決に向けた研究がしたいと思ってきました。そこで着眼したのは、企業の社会的責任論です。

人権や労働環境の向上が企業の社会的責任と考えるのなら、女性の労働問題の解決も企業の社会的責任のひとつだと考えたからです。

企業の社会的責任論として女性の労働問題を考えていくと、企業が人間をどのように扱おうとしているのかがわかります。

それは突き詰めると、女性だけの問題ではなく、障害のある方や外国人などのマイノリティ側の人たちが働きやすい環境を、企業がどのようにつくろうとしているのか、それが企業や組織の成長にどうつながっているかがわかります。

つまり、ダイバーシティ・マネジメントにつながっているわけです。

私はこれまでジェンダー研究者として、男性と女性の違いに注目してきましたが、その違いを明らかにするだけでなく、社会を変革するモノやサービスの開発へ自身の研究を転換させたいと強く思うところがあったので、ジェンダード・イノベーション研究所へ所属することになりました。

富士通研究所人工知能研究所AIイノベーションコアPJ シニアリサーチマネージャーの新田泉さん

━━続いて新田さんからは、「富士通スモールリサーチラボ」が、お茶の水女子大学と共同研究をすることになった経緯をお教えいただけますか?

新田さん(以下敬称略):富士通スモールリサーチラボは、中長期的な社会課題解決を目指し、現在、日本国内に13拠点、海外に4拠点を設置し、産学連携の活動を行っています。

お茶の水女子大学とのスモールリサーチラボでは、社会課題の一つとしてジェンダー課題の解決に取り組みます。

また、富士通がジェンダー課題に取り組む背景として、富士通のマテリアリティ(組織にとっての重要課題)があります。富士通は、「イノベーションによって社会に信頼をもたらし、世界をより持続可能にしていく」というパーパスに基づいてビジネスを推進しています。

私たちが定めるマテリアリティの土台には、「テクノロジー」、「経営基盤」、そして、社内外の多才な人材が俊敏に集い、社会の至るところでイノベーションを創出する「人材」があります。

このような背景から、ジェンダー課題の中でも人材に焦点を当て、この共同研究のテーマを、人材領域におけるジェンダー課題の解決としました。

また、多くの企業が、D&Iの目標のひとつとして、「203030目標(2020年代の可能な限り早期に指導的地位に占める女性の割合が30%程度)」の達成を目指しています。

富士通を始め、IT業界における女性の採用比率は増えてはきたものの、依然としてIT業界に関わる女性は多くはなく、入社後にいかにキャリアを構築するかということに関しては課題が多いままです。

そこで、これまで様々な共同研究を通して長年のお付き合いがあったお茶の水女子大学のジェンダード・イノベーション研究所の斎藤先生に、一緒に人材領域におけるジェンダー課題に取り組みませんか、とお声がけをさせていただきました。

━━さらにそこに、AI技術を掛け合わせることになったのは、どういった背景からでしょうか。

富士通はAIの開発企業として、AIで様々なデータを分析し、今まで見えていなかったことを可視化させ、そこから有効な施策を生み出したいと考えています。

最終的には人が意思決定をして施策を打つことになりますが、そこを支援するのがAIです。

人だけで判断を下すと、どうしてもバイアスがかかってしまいます。例えば、意思決定をするグループの大多数が同じ属性に偏るときには、同質な考え方や価値観に決定内容が左右される可能性があります。

AIの力でバイアスを可視化、分析すれば、バイアスがあったことに気づくところまではできますが、それをどのようにして解決すべきかに関しては、今までのジェンダー研究の示唆が非常に重要です。どちらかだけではなく、両輪で研究を進めていくことで、大きな社会課題解決につなげていけると信じています。

社会科学系の研究者と企業の産学連携の難しさ

━━「富士通・お茶の水女子大学 AI倫理社会連携講座」でのそれぞれの役割、また、設立されてから現在に至るまで、苦労された点などはありますか?

斎藤:私たちの役割は、ジェンダー領域における本質的な課題を、AI開発を手掛ける富士通さん側に示すことです。

社会科学や人文系の研究室は、理系とは異なり、企業と一緒に研究開発に取り組むことはそう多くありません。

企業側のスケジューリング、目標へのコミットメントや達成までの設計などを、グローバル企業である富士通さんから教えていただき、驚くことも多くありました。

富士通さんも、理系の研究室との共同研究は慣れていらっしゃるかもしれませんが、今回のような、社会科学系の中でもジェンダー研究という、これまでとはだいぶ性質が違う分野との共同研究で、苦労も多いのではと感じています。

ジェンダー課題の解決方法については、お互いアイデアを出しながら現在検討を進めている最中です。きっと来年の終わり頃には、素晴らしいものができるのではと楽しみにしています。

新田:この講座が始まる前は、私たちはAI倫理に関する研究を行っていました。

例えば、採用、 ローンの審査などのシーンでAIを活用すると、なぜ男性ばかりが得をするような結果になってしまうのか、それをどう「公平な状況」に戻していくか、という内容です。

その研究を通して分かったことが、採用の場面で女性に不利になるバイアスがないかAIで分析する今回の研究にそのまま活用できるかというと、そうではありません。

テーマや対象が変われば、導き出す答えも変わるので、この研究ならではの公平性を分析し、追求しなくてはならないからです。

そこで、斎藤先生方の研究から、思考や行動における男女の特性の違いを教えていただき、性別だけで区切ることのない、公平な採用方法を模索しています。

そしてそのバイアスをなくすための施策に、AI活用の面で私たちが役立つことができればと考えています。

採用面接でジェンダーバイアスを解消するには?

━━将来的には、採用領域でAIがどのように活用される仕組みを目指しているのでしょうか?

新田:例えば、1回の新卒採用だけで男女比率を平等にしようとした時に想定されることとして、その職場が一度にたくさんの女性を受け入れる状態が整っていないことなどがあります。急激な変化を組織に求めることは、とても難しいことです。

短期的な目標達成を目指すより、「203030目標」というゴールに向けて、毎年の採用のフィードバックを反映させながら改善を進めていく仕組みを考えています。

現在は、書類選考よりもその先の面接の方にバイアスがかかっているのでは、という仮説が見えてきた段階です。そこで、今年のテーマとして、採用面接の段階におけるジェンダーバイアスに焦点を当て、AIを活用したバイアスの検知や緩和策の提案に取り組んでいます。

斎藤:去年は新卒採用面接に関する研究において、 何が合否の評価基準になっているのか、面接の方法も含めて、企業5社にインタビューを実施しました。

それぞれの企業がもつ評価基準は、論理性のある人間であるかどうか、リーダーシップがあるかどうかなど、一見するとジェンダーニュートラルな基準でした。ただ、最終面接に近づくにつれて、面接官の男性比率が高まっていく傾向がありました。

その面接官の判断にジェンダーバイアスがかかっていれば、合否結果に影響が出る可能性があるということもわかってきました。

このジェンダーバイアスをなくすために、富士通さんが得意とされているバイアス緩和AIを活用することで、今よりも男女平等な採用の形に近づくことができたらと考えています。

また、将来的には採用に限らず、女性管理職比率向上にも寄与する形で、昇進面接の際にも活用することができるのではと期待しています。

社会を映す「鏡」でもあるAIを活用する可能性

━━一般的に、AIに学習させる側の人間のジェンダーバイアスが影響してAI自体もバイアスを持つことへの懸念が議論されることもありますが、本研究を進めるにあたってはどのような配慮がされているのでしょうか?

新田:欧州連合(EU)では来年度にはAI規制法が施行され、日本でもAIの法規制の議論が始まりましたが、富士通では2010年代の後半からAI倫理を重視した取り組みを進めています。

また、2022年にはAI倫理ガバナンス室を設立しました。AIの商品企画の段階から、そのAIが倫理的に問題がないか、開発者、運用者、知財、法律の観点から社内でチェックしています。これは、本研究においても同じ仕組みで進めています。

━━最後に斎藤先生から、今回の研究に限らず、性差を活かす形でのAI活用として、ジェンダード・イノベーションの可能性を感じられるアイデアなどはありますでしょうか?

斎藤:AIは社会を映す「鏡」でもあります。それを利用し、AIが反面教師となる形で、人々が持っているアンコンシャスバイアスに気づきを与えるというのは、いろいろと配慮が必要だとは思いますが、面白い取り組みになるのではないかと思っています。

今回の研究では、人物評価における性別の影響を考えることが社会科学チームの最初のステップでした。

男性であること、女性であることは一体何を意味するのだろうと考えると、性別はその人のアイデンティティの根幹となる重要なものであり、それは評価する方もされる方も共通であるわけです。

例えば、エントリーシートに性別を書かない、面接でも性別をわからない状況にしてしまえば、公平な評価ができるかもしれないと考えたこともありましたが、性的マイノリティも含めて性別はその人のアイデンティティです。それをないものとして扱えば、その人ではなくなってしまいます。

これまでの経済社会においては、ジェンダーバイアスによって、女性であることが男性に比べるとネガティブに作用してきた点が問題点でした。

性差の研究を通じて、性別による決めつけから社会が自由になることが、真のジェンダード・イノベーションなのではないかと思っています。

この記事が気に入ったらサポートをしてみませんか?