#deeplearning

"AI" と"機械学習"と"ChatGPT"と・・・

AI、人工知能や生成AIという言葉がよく使われています。このAIを実現できる一つの手法として機械学習があります。通常、人が考えて実行していることを人が介さず自動で行うことができるものとされています。

ChatGPTは機械学習の中でも深層学習(ディープラーニング)という技術が使われています。

機械学習

機械学習はデータの中のどの要素が結果に影響を及ぼしているのか(特徴量という)を人間が判断、調

やってみよう!機械学習 - 勾配降下法

何はともあれ以下のサイトを参考にColabで実行します。

少しコードを削除したも。以下を実行します。

import matplotlib.animation as animationimport matplotlib.pyplot as pltimport numpy as npdef objective(x): return x**2def differential(func, x):

PyTorch - Training a Classifier

ここでは画像を使って分類の仕組みを見ていきます。

torchvision

を使います。

For this tutorial, we will use the CIFAR10 dataset. It has the classes: ‘airplane’, ‘automobile’, ‘bird’, ‘cat’, ‘deer’, ‘dog’, ‘frog’, ‘horse’, ‘ship’,

PyTorch - Neural Networks! - 2

ネットワークができたのであとは精度を上げていきます。

ここから「学習」です。ネットワークで正解と比べ、間違わないように最適化していきます。ネットワークから出力されるデータと、正解データとを見合わせながらパラメータを調整していきます。

まず最初に全てのパラメータを"0"にして次のステップの準備します。総てのパラメータの勾配バッファをゼロにして勾配を初期化し, 逆誤差伝播法でパラメータの値の最適な

PyTorch - Neural Networks! - 1

このサイトわかりやすいです。

さて、PyTorch 1.5 Tutorialsの3回目のNeural Networksです。

PyTorchで作るニューラルネットワークです。ここで使われているのはいわゆる畳み込みニューラルネットワークです。

ニューラルネットワークのための典型的な訓練手続きは以下のようなものです

・幾つかの学習可能なパラメータ (or 重み) を持つニューラルネットワークを

PyTorch - Autograd: 自動微分

PyTorch 1.5 Tutorialsの2回目です。順番にやっていきます。

"autograd"自動微分です。

"Central to all neural networks in PyTorch"ということでPyTorchでニュートラルネットワークを組み上げる時に中心となるものです。

そしてもう一つ大事なものがあります。"torch.Tensor"です。これは

.requires_g

PyTorch - 始めてみましょう!

PyTorchが1.5になりました。公式のチュートリアルが翻訳されていますのでそれを見ながらGoogleのColabを使って試しながらみていきます。

GoogleのColabについてはすでに1.5サポートされています。Colabを開いて、以下コマンドを打てば、

import torchprint(torch.__version__)

1.5.0+cu101

と確認できます。

チュートリア

PyTorch 1.5.0 release!

日本語訳されています。

PyTorch 1.5.0 は Python 2系のサポートはしないということです。

こちらのサイトで変わったところなど説明があります。

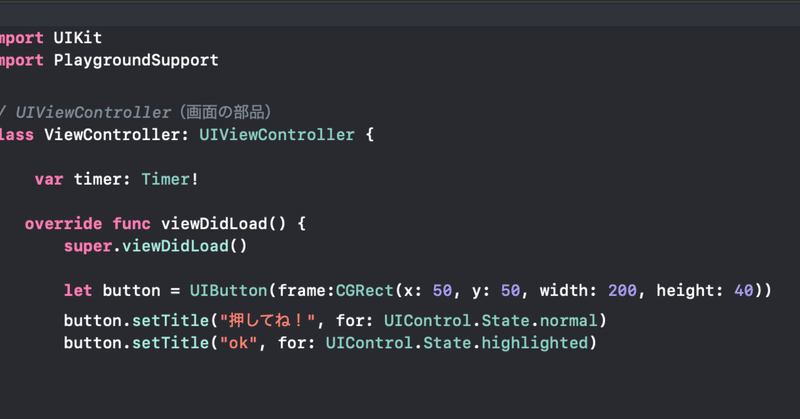

Swiftでいこう! - Core ML を変換、作る!

機械学習をアプリに取り込むときに便利なCore MLです。

今、もうすでにあるモデルを取り込むときは?ということで変換する便利なツール。Core ML Toolsです。

そして、自分で学習させて自分で作る便利なツールが、Create MLです。

Core ML Toolsでは、Core MLのモデル形式(.mlmodel)に変換して使えるようにします。多くはPythonで作られているのでPy

Deep Learning 考え方まとめ。

イメージを膨らませていきたいと思います。

"ゼロから作る Deep Learning"のコードを参考に考えていきます。

まず、必要なものとしてはネットワーク。単純化して

"重みの決定(初期化)"、"推論"、"検証(損失関数)

とします。

class simpleNet: def __init__(self): // "重みの決定(初期化)

Pythonで勾配降下法 - 最適化について

なんだかわかりにくい。理解が足りないので整理します。

ある関数があってその極小値を知りたい。という場合に使う方法。

ある関数の底を知るためにはまずはある地点の勾配を知ることが必要になるのでその計算式が必要。勾配についてはその地点の微分をすれば良い。

必要なことその1 微分 numerical_gradient(f, x)

ある地点の勾配がわかったので勾配の低い方へ移動して行かないとい

TensorFlow - 初心者のための〜

公式ページです。

"初心者のための TensorFlow 2.0 入門"をColabで実際にコピペで動かしてみるとうまくいきます。

まずは"import"からですね。

from __future__ import absolute_import, division, print_function, unicode_literalsimport tensorflow as tf

MNISTも

PyTorchでDeep Learning実装。- 学習

https://note.com/dngri/n/n16991ef1f828

の続きです。まず流れですが、

クラスの実体化、データを読み込み、そして訓練(tranning),テスト(test)としていきます。最後にはグラフで学習率を可視化しています。

ネットワーク、データが用意できたので学習させる実行部分です。最初に基本的なものを決めていきます。学習回数、保存用の変数、ネットワークの実体化と