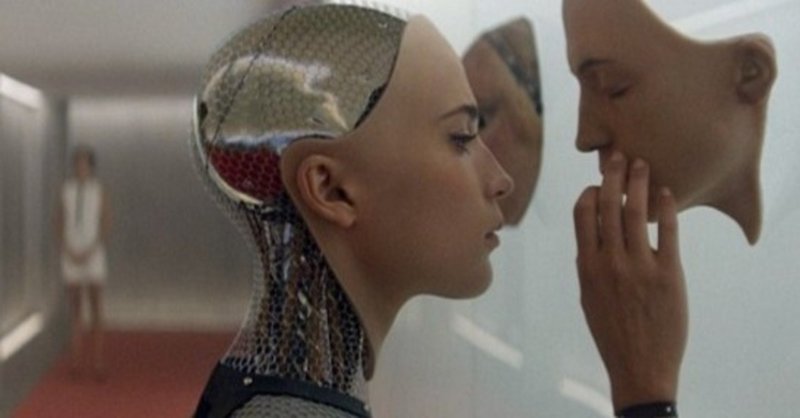

第1回「ロボットは共感できるのか?」

Philosophianの哲学カフェ、記念すべき第一回目。

私達は「共感」をテーマにして話しました。

今後、AIを使ったロボットが様々な現場に導入される未来が想像できます。

ドラえもんのように、人の生活に寄り添ったようなロボットが登場するのも夢の話ではないかもしれません。

次のような場面を想像してください。

あなたはAI搭載したロボットと生活をしています。

そんなある日、あなたはある悲しい映画を見ました。

その映画を観て悲しみのあまりあなたは涙を流しました。

同時にロボットも涙を流していました。

さて、ロボットはその映画に「共感」をして涙を流したのでしょうか。

そもそも共感とは何か?について議論をしました。

「共感」は必要か?

共感とは何か?について考え始める前に、まずは「そもそも共感は必要か?」について考え始めました。

たとえば、多くの人々を自分と同じ方向に向かわせるとして、そのために共感は必要なのでしょうか?

一つの見解として、「共感がないと力ずくになる。平和な世の中を作るためには共感が必要」という意見がでました。

共感か強制か、というわけです。

そして共感を得るためには論理的な説明が必要だ、という意見が出ました。

つまり、きちんと道筋立てて話をすることが人から共感を得るために必要なことだというわけです。

しかし、果たしてただ論理的な人だけが人の共感を得ることができるのでしょうか?

ここには共感と理解の違いがあります。

共感と理解

「理解」とは、「物事の道理や筋道が正しくわかること」です。

死を回避するなどの自体に置いては「理解」が発生して、選択がなされる。

したがってある論理的な事柄については「理解」が働いているというわけです。

先の「人々を同じ方向に向かわせる」については人の「理解」によってできているということになります。

ではロボットが悲しい映画を見て泣いたのは、理解によるものなのか、共感によるもの、どちらなのでしょうか?

それは、私達が対象のロボットに心があると考えるのかどうかだと考えました。

現実のロボットでペッパーくんがいます。

ペッパーくんは、統計処理による学習能力があり、相関性の中で相手にとってベストな選択をします。

つまりペッパーくんは自身に備わったメカニズムによって作為的に選択を行っているとみなすことができます。

そうしたロボットには共感が備わっている、つまり心があると考えられるでしょうか?

私達はペッパーくんのようなロボットに共感が備わっているとは考えず、共感が備わっているとみなすには一種のブラックボックス性が必要だと考えました。

つまり、裏にメカニズム(技術者)の作為性(たとえば、こういう言葉を言ったら、こういうレスポンスが返ってくるなど)がないことが重要だと考えました。

したがって、ある対象に共感が備わっているとみなすかどうかは、その対象の行動に作為性がなく、心が備わっているとみなすことが必要になります。

では、作為性が明らかなロボットには共感がないのでしょうか?

必ずしもそうとは言えないと考えました。

ロボットと一緒に生活をして過ごしていったら、その対象について共感が生まれるかもしれません。

そのロボットとどれだけの付き合いがあるか、たとえば生活をともにしているか、ということがロボットに共感があるとみなす一つのポイントになると考えました。

したがってどのようなロボットであっても心理的・物理的な距離が近ければ、そのロボットに共感が備わっているとみなすことがありえます。

今後介護などの現場にロボットが導入されるとして、大事になるのは人がロボットをロボットとして扱うのかどうかだと思います。

人がロボットに心が備わっているとみなす、つまり共感することができるようになると、人はロボットを人として扱うようになるかもしれません。

人とロボット

私達がロボットを生活の一部として受け入れることができるかどうかが、ロボットに共感があると考えられる重要な点だと思います。

終わりに

以上のように、話は「共感」を中心に様々な方向に広がっていきました。

また、最初の段階ではロボットにも心が存在する必要があるかのように議論を進めていました。

しかし議論が深まっていくにつれて、ロボットに心があるかないかに関わらず、「共感」は成立するという結論に至りました。

この記事が気に入ったらサポートをしてみませんか?